Veri Merkezimizi Yalnızca 8 Günde ve (Neredeyse) Sıfır Kesintiyle Nasıl Taşıdık?

Yönetici Özeti;

Müşterilerimizin hem public hem de local ip’leri sabit kalacak ve herhangi bir veri kaybı olmayacak şekilde, high-available cluster şeklinde tasarlanmış yapılar için SIFIR dakika, bu şekilde tasarlanmamış yapılar için azami 8 dakikalık kesinti ile veri merkezleri arasında yüzlerce sanal sunucuyu başarıyla nasıl taşıdık.

İlk servis noktamız IST1 kodlu veri merkezimizdeki servislerimizi, IST5 kodlu yeni veri merkezimize taşıdık.

Temel hedefimiz, hem müşterilerimizin sistemlerinde hem de kendi sistemlerimizde, WAN ve Local IP adresleri ile ilgili bir değişiklik yapmadan, kesinti ve veri kaybının yaşanmadığı pürüzsüz bir göç gerçekleştirmekti.

Peki bunu nasıl başardık?

TTEN, özgür yazılım ve open-source projelerin aşığı bir ekipten oluşuyor. Bu göçü gerçekleştirmemizi sağlayan ve halihazırda Disaster Recovery hizmetimizin de temelini oluşturan CEPH’in temel nimetlerinden faydalandık.

Kullandığımız altyapı bileşenleri için TL;DR:

1. CEPH

2. KVM

3. VXLAN

Bu dokümanda, altyapı bileşenlerinden veri replikasyon yöntemlerine, VXLAN/IPsec tünellerinden BGP anonslarına kadar, -meraklıları için- faydalanması umuduyla ayrıntılarını paylaşacağız.

IST1 kodlu veri merkezimizin çetelesi kısaca:

Toplam 32 KVM hypervisor

Her bir hypervisor üzerinde 8’er adet olmak üzere toplam 256 adet NVMe disk

256 adet OSD üzerinde çalışmakta olan 3 adet CEPH Pool

Ceph Pool’lar üzerinde bulunan 450 TiB veri (3 replica x 150 TiB efektif)

Yüzlerce VM (web sunucusu, veri tabanı kümeleri, firewall sanal sunucuları, vb.)

Tüm bu sistemi 8 gün gibi kısa bir sürede yeni lokasyonumuza taşımayı hedef tahtamıza koyduktan sonra, zaman baskısının nasıl bir his olduğunu kariyerleri boyunca defalarca deneyimlemiş bir ekip ile ilk günümüzün tamamını planlamaya ayırdık ve uçuş planımızı oluşturduk. Sürecin hangi adımında ne yapılacağına dair fikir birliğine vararak operasyonumuza başladık.

Operasyonun ikinci gününde, kendimizi veri merkezine kapattık ve çoğunlukla fiziksel efor gerektiren kurulumları gerçekleştirdik. IST5 veri merkezinde yeni backbone router, switch ve hypervisor’larımızı devreye aldık. Bu yeni altyapı, başlangıçta planlandığı gibi ufak bir küme olarak hayatına başladı.

Geçiş sürecinde internet prefix’lerimizin her iki veri merkezinde de çalışabiliyor olması temel zorunluluk olduğundan IST5’te altyapının devreye alınmasıyla birlikte ilk iş olarak VXLAN yapılandırılmasını gerçekleştirdik.

İnternet prefix’lerimizin bulunduğu VLAN’ımızı internet service sağlayacılarımızın (İSS) desteği ile VXLAN şeklinde uzatıldı.

İnternet trafiğini taşıyan VLAN’ımızın, VXLAN ile uzatılması ile birlikte olası MTU(Maximum Transmission Unit) size sorunlarının yaşanmaması için bu kısmı İSS’lerimizin cihazları üzerinden gerçekleştirilmesini sağladık.

Böylece IP prefix’lerimizi hem IST1 hem de IST5 veri merkezlerimizde aynı anda kullanabilir duruma geldik.

TTEN’in sağlamakta olduğu Sanal Veri Merkezi (SVM) - Virtual Datacenter (VDC) hizmeti ve network katmanı topolojisi sırasıyla:

Her VDC ürünü sanal bir firewall içeriyor.

Firewall WAN bacağında, müşteri ihtiyacı kadar WAN IP adresi bulunuyor.

Firewall LAN bacağı ise VDC’ye özel VLAN bağlı durumda bulunuyor.

Müşterilerimiz, IP NAT ihtiyaçlarını TTEN’in Core Panel’ini kullanarak gerçekleştiriyor.

IP prefix’lerimizin BGP anonslarını /24 olarak yapılıyor.

Müşterilerimizin WAN IP ihtiyaçları, anons edilmekte olan prefix’ler içerisinden seçilen IP adreslerinin müşterilerimizin firewall’larına tanımlanması ile karşılanıyor.

Böylece ilk VDC göçü için hazır duruma geldik ve ilk testlerimize başladık. Başarılı geçen testler sonrasında göç operasyonunu devreye aldık.

Göç için planladığımız adımlar şu şekilde idi:

1. Göçü gerçekleştirilecek VDC ürününe ait sanal sunucuların sanal disklerini seçerek CEPH’in RBD Mirror deamon’ı ile IST1 lokasyonundan IST5’e mirror edilmesini sağlamak.

2. Snapshot mirroring schedule’larını oluşturmak.

3. İlk senkronizasyon sonrası, oluşan fark verilerininin 5 dakikada bir tekrar senkron edilmesini beklemek.

4. Tüm verinin aktarılmasının ardından, fark verilerinin de 5 dakikalık süreç içerisinde aktarılabildiğine emin olduğumuz anda, müşterilerimizden 10 dakikalık bir kesinti için zaman aralığı talebinde bulunmak.

5. VDC’ye ait tüm sanal sunucuların kontrollü bir şekilde power-off etmek.

6. Bir sonraki rbd-mirror işlemi ile tüm fark verisinin aktarılmasını beklemek.

7. Fark verisinin aktarımı sonrasında VM konfigürasyon dosyalarını senkron etmek.

8. VDC’yi IST5’te aktif hale getirmek

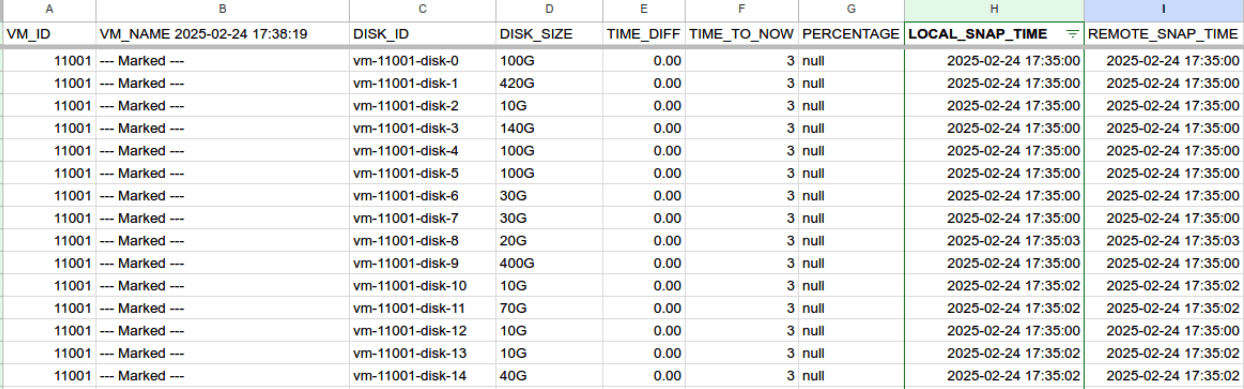

“rbd mirror pool status IST1-CEPH1-RBD2 --verbose“ çıktısı, insan gözü ile okumaya çok müsait değil. Bunu, ihtiyaç duyduğumuz haliyle parse ederek, CSV formatına çevirmek ve her dakika başı yenilenen bir spreadsheet’e çevirerek okumayı kolaylaştırmak için basit bir bash script geliştirdik:

Google Spreadsheets’in App-Script özelliğini kullanarak, crontab’ler ile oluşturulan bu CSV dosyasının her dakika başında güncellenmesini sağladık.

Müşterilerimizin VDC ürünleri, IST1 veri merkezinde kapalı hale gelip, IST5 veri merkezinde aktif edildikçe, IST1 lokasyonundaki ihtiyaç duyulan kaynak giderek azalmaya başladı.

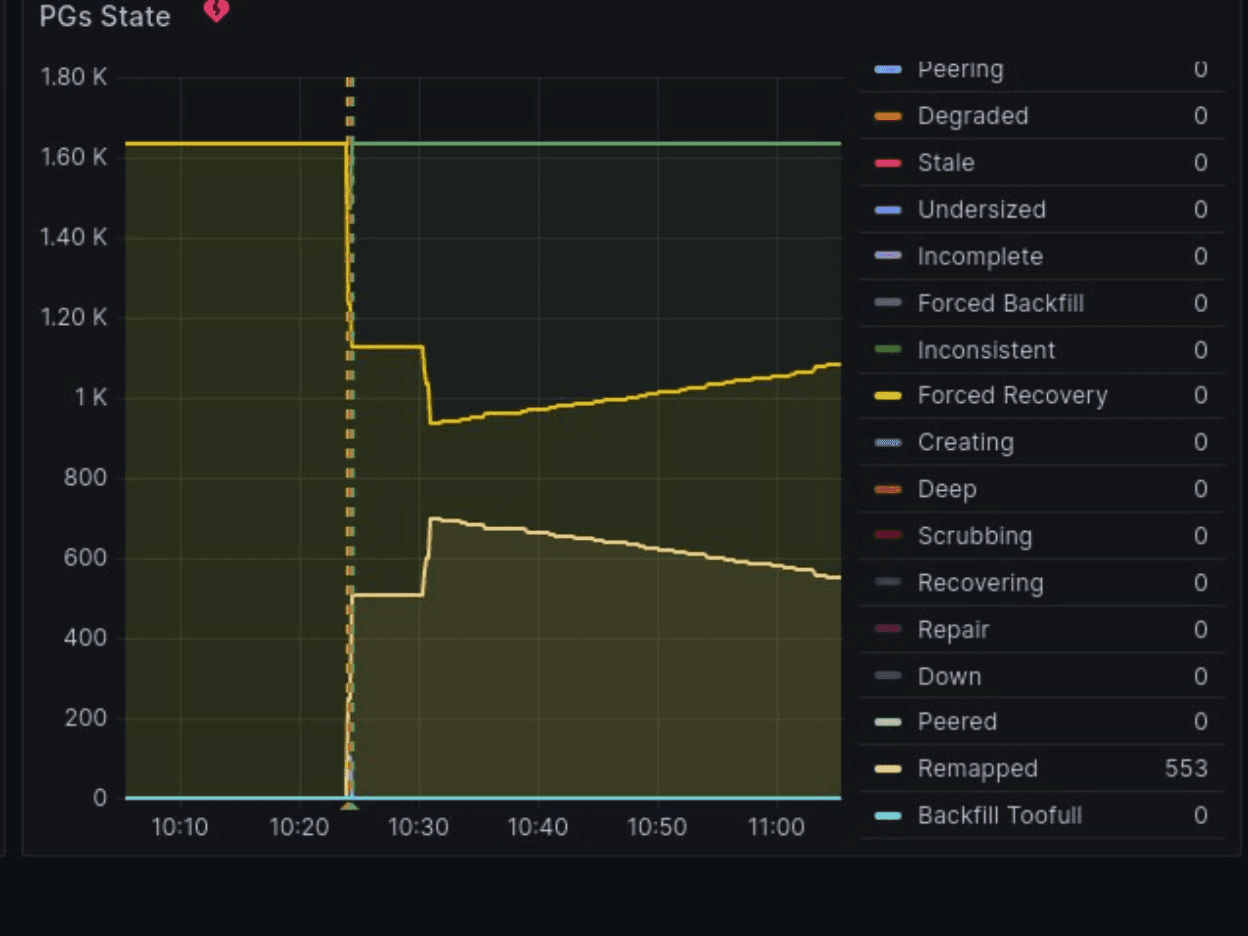

IST1’den 10 adet hipervizörü devreden çıkarabileceğimiz kadar sanal sunucuyu IST5’e aktarmamızın ardından, ilgili hipervizörler üzerinde yer alan OSD’leri devre dışı bıraktık.

Bu aşamada yapılması gereken sabırlı bir bekleyişti.

CEPH Placement Group’larının Crush Map’e göre rebalance işlemleri tamamlandıktan sonra, IST1 veri merkezimizden ilgili hipervizörleri teslim aldık ve IST5 veri merkezimizde, yeni hypervisor ve CEPH kümemizin altında çalışacak şekilde yapılandırdık.

Her bir fiziksel işlem sonrasında (eski kümeden hipervizör çıkarılması, yeni kümeye hipervizör eklenmesi) sabırlı bekleyişlerimizi sürdürmemiz gerekiyordu.

Fiziksel taşıma süreçleri için IST1 veri merkezini toplamda 4 kere ziyaret etmemiz gerekti.

Son VDC göçü tamamlanana dek tüm internet prefix’lerimizin IST1 veri merkezimizinden BGP anonsu devam etti. Göçün ardından IST1’in BGP anonsu kapatıldı ve IST5 üzerinden aynı bloklar anons edilmeye başlandı. Anonsun IST1’den kesilerek IST5’ten yapılması için 1 dakikayı bulmayan bir kesinti daha gerekti.

Geçiş sürecinde, HA Cluster ( High Availability - Yüksek Erişilebilirlik) yapıları bulunan müşteri sistemlerinde SIFIR kesinti ile başarılı geçişler mümkün oldu.

Örnek olarak Percona XtraDB Cluster’ı olan müşterilerimizin VLAN’larını da, aynı internet VLAN’ı taşıdığımız gibi VXLAN ile hem IST1 hem de IST5 lokasyonlarında çalıştırdık.

Clustered yapılarda topyekün tek seferde tüm VDC sanal sunucularının göçü yerine, müşterilerimiz ile koordineli bir şekilde, kontrollü olarak VM bazlı göçü gerçekleştirdik ve bu süreçte sıfır kesinti tecrübe eden müşterilerimizde oldu.

Ancak kesinti süresi en uzun olan bir VDC’nin göç operasyonunu düşündüğümüzde, toplamda maksimum 8 dakikalık bir operasyon kesintisi ve 1 dakikalık final BGP anonsunun değişimiyle birlikte gelen kesinti ile tüm süreci müşterilerimize 10 dakikanın altında bir kesinti yaşatarak tamamladık.

Bütün bu işlemleri, 8 gün gibi kısa bir sürede gerçekleştirdik.

Hedeflediğimiz gibi tüm müşterilerimizin WAN ve Local IP adresleri değişikliğe uğramadan göç işlemleri tamamlandı.

Sanal Veri Merkezi (VDC) Nedir? Kurumsal Bulut Altyapısına Kapsamlı Bir Bakış

Veritabanı Nedir? Türleri, Örnekleri ve Kullanım Alanları [2026]

Proxmox Helper Scripts Nedir?